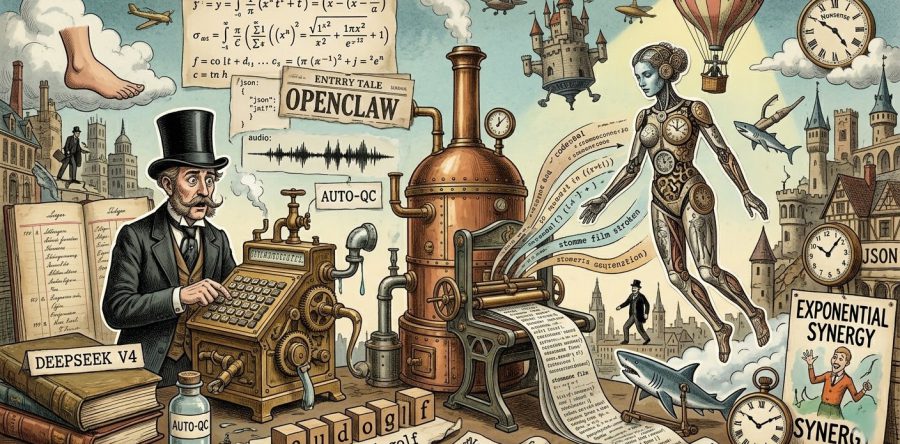

In de wereld van AI-ontwikkeling is er een groot verschil tussen 'leuke experimenten' en 'productieve harmonie'. In mijn zoektocht naar het ideale digitale maatje voor een complex creatief proces – van lange video’s tot audio en images – ben ik een avontuur aangegaan met OpenClaw. Een avontuur dat me leidde langs de grenzen van de cloud, tot ik de sleutel vond bij een nieuwe speler: DeepSeek.

De Start: Harmonie met Route-LLM

Voor iedereen die het OpenClaw-avontuur wil aangaan, is er één advies: begin bij Route-LLM. Het werkte voor mij lange tijd perfect. Het mooie van dit systeem (via Abacus AI) is de veelzijdigheid; alle topmodellen staan voor je klaar en het systeem schakelt automatisch op basis van je vraag. Het is de ideale "instap-harmonie" voor een creatief proces waarin je niet constant zelf wilt knutselen aan de achterkant.

De Muur: Context en Kostbare Tokens

Maar wie groot bouwt, loopt tegen grote limieten aan. Mijn project – het aansturen van een complete pipeline voor lange video's – vereist dat mijn agent een enorm geheugen heeft. OpenClaw moet constant grote hoeveelheden documentatie en geschiedenis meesturen.

Hier liep ik tegen twee grote problemen aan:

- De "Vergeetachtigheid": De standaard modellen kwamen context-geheugen tekort voor de complexe structuren die ik bouw.

- De Token-rekening: Omdat er geen sprake was van caching, betaalde ik bij elke vraag opnieuw voor de volledige set aan instructies en documenten.

Ik heb Gemini geprobeerd via Google Studio. Hoewel Gemini fantastisch kan cachen, merkte ik dat Google's API een agent-workflow (zoals OpenClaw) vrij snel blokkeert. Iets wat bij Route-LLM nooit gebeurde, maar daar miste ik weer de broodnodige efficiëntie.

De Revolutie: DeepSeek V4 (April 2026)

Rond 25 april 2026 gebeurde er iets waar de hele AI-community van opkeek: de release van het nieuwste DeepSeek model. Er wordt veel beweerd in de media, maar in mijn wereld geldt: meten is weten.

De eerste resultaten van mijn tests zijn spectaculair:

- Slimme Caching: DeepSeek begrijpt dat mijn "Tool Docs" niet veranderen. Dankzij hun Prefix Caching betaal ik nu tot 90% minder voor de tokens die mijn documentatie in beslag neemt. In recente logs zag ik een Cache Hit ratio van maar liefst 85%!

- Agent-vriendelijk: Waar andere grote partijen drempels opwerpen voor agents, laat DeepSeek de teugels vieren.

- Beter Context-behoud: Het model houdt de rode draad van het creatieve proces feilloos vast, zelfs bij enorme bestanden.

De Volgende Stap: De Intelligente Herstel-Loop

Nu de infrastructuur staat, kan het echte avontuur beginnen. Ik heb tools ontwikkeld waarmee OpenClaw de kwaliteit van een video kan controleren via specifieke wiskundige berekeningen voor beeld, audio en spraak. In feite is deze toolkit een slimme agent-flow die gezamenlijk een eindoordeel velt over het gemaakte werk.

Auto-QC: Zelfcorrigerend Vermogen

Wanneer de sensoren een fout detecteren, treedt een automatische herstel-loop in werking die menselijke interventie overbodig maakt:

- Detectie: De QC-agent markeert een scène als "mislukt" (bijv. door een foute balans in de muziek).

- Analyse & Re-prompting: De AI-agent analyseert de fout en herschrijft de instructies met extra nadruk (bijv. "no music, raw ambient only").

- Reproductie: Een nieuwe versie wordt gegenereerd en direct opnieuw gescand door de wiskundige sensoren.

- Validatie: Dit proces herhaalt zich (tot max. 6 keer) totdat de kwaliteit gewaarborgd is.

Kortom: Auto-QC is een onvermoeibare, intelligente orchestratie die video's niet alleen controleert, maar ze autonoom verbetert tot ze aan de standaard voldoen. Pas als de machine er na zes pogingen echt niet uitkomt, wordt er menselijke hulp ingeschakeld.

Het OpenClaw-avontuur gaat verder, maar dan zonder de angst voor een 'leeg' geheugen of een onbetaalbare token-rekening. De machine leert, corrigeert en creëert – in volledige harmonie.